팟캐스트 전사문을 생성해주는 기능인데 살면서 본 그 어떤 ASR 모델보다 정확함

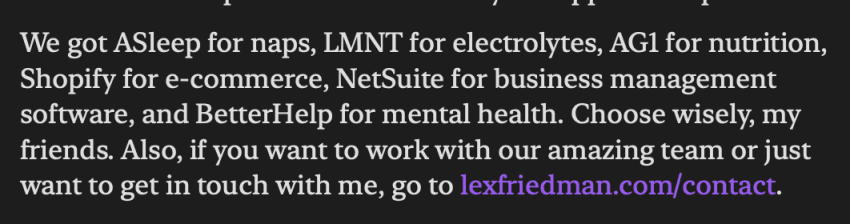

얼마나 정확하면 웹사이트 링크 부분까지 정확히 인식해버림

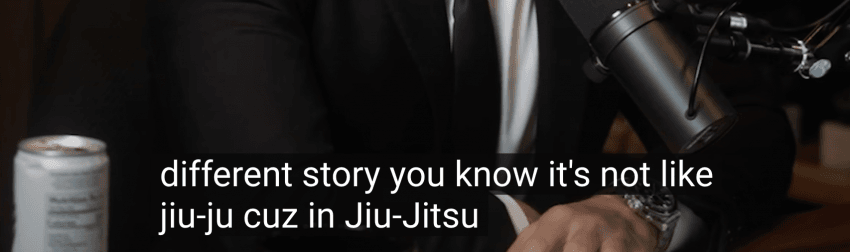

이 분야 최강이라는 구글도 이런식으로 주짓수를 잘못 인식해서 jiu-ju 라고 잘못 삑나가는 경우들이 자주 보이는데

애플 팟캐스트 전사문은 정확도가 거의 100%에 수렴함... 빗나가는걸 본 적이 없음

현재까지 나온 AI 기능들은 자동생성되었다거나 AI에서 생성되었다고 고지하고 제한적으로 사용하는데 비해

애플이 만든 ASR모델은 너무 완벽에 가까워서 그냥 상용서비스에 정식 기능으로 통합시켜버림

사람이 수동으로 하는 수준의 정확도까지 올라왔다는 의미겠지

이정도로 진보한 모델을 만들고도

간단히 "팟캐스트 전사문 기능 생김 ㅇㅇ" 고지하고 말았다는것도 존나 시크함

해당 기능 개발팀 인터뷰 올라왔길래 번역해서 올림 ㅇㅇ

애플 팟캐스트 전사 기능, 출시까지 6년 걸려

벤 러브조이 작성 | 2024년 6월 17일 - 오전 5:09

애플의 팟캐스트 전사 기능은 iOS 17.4에서 공식적으로 출시되었지만, 사실 이 회사는 2018년에 매우 제한된 버전을 도입했다고 밝혔다. 애플은 이 기능을 완전한 접근성 기능으로 출시하는 데 오랜 시간이 걸린 이유는 이 기능을 보편적으로 만들고, 애플 뮤직의 가사 기능에서 배운 점을 통합하기 위해서였다고 설명했다.

애플의 글로벌 팟캐스트 책임자인 벤 케이브는 가디언과의 인터뷰에서 첫 번째 구현이 2018년으로 거슬러 올라간다고 말했다. 애플의 팟캐스트 전사 기능의 여정은 다른 기능인 인덱싱의 확장에서 시작되었다. 이는 아마존과 야후 같은 여러 기술 회사에서 흔히 볼 수 있는 기원 이야기로, 검색 도구로 시작된 것이 전체 전사 이니셔티브로 발전한 것이다. 애플은 2018년에 팟캐스트에서 특정 단어를 식별할 수 있는 소프트웨어를 처음 배포했다.

케이브는 “그 당시 우리가 한 일은 특정 검색 결과에 대해 사용자에게 맥락을 제공하기 위해 전사의 한 줄을 제공하는 것이었습니다.“라고 회상했다.

전사 기능을 완전히 롤아웃하는 데 왜 그렇게 오랜 시간이 걸렸을까? 애플은 두 가지 이유를 들었다. 첫 번째 이유는 최고의 사용자 경험을 제공하는 것이었다.

애플은 높은 성능, 디스플레이, 정확성의 기준을 추구했다. 큰 진전은 애플의 다른 부서에서의 접근성 혁신에서 나왔다. 팟캐스트 정책 리더인 사라 헤어링거는 “이 경우, 우리는 애플 북스에서의 독서 경험과 애플 뮤직의 가사 기능에서 배운 최선의 것들을 활용했습니다.“라고 말했다. 애플 팟캐스트 전사는 애플 뮤직에서 단어별 하이라이트 기능을 빌려와서 시각 장애인을 위해 애플 북스의 글꼴과 대조 색상 체계를 사용한다.

올바르게 구현될 때까지 기다리는 것은 물론 애플의 특징이다. 유튜브는 2009년에 비디오에 대한 자동 자막을 출시했지만, 종종 웃음거리가 되곤 했으며 청각 장애인 사용자들은 이를 “엉터리 자막”이라고 불렀다.

두 번째 이유는 모든 쇼의 모든 에피소드에 대해 사용 가능하게 하고자 했기 때문이다. 케이브는 “우리는 모든 쇼에 대해 이 기능을 제공하고 싶었기 때문에, 카탈로그의 일부에만 적용하는 것은 적절하지 않다고 생각했습니다. 접근성 관점에서 모든 사람들이 상호작용하고 싶은 모든 것에 대해 전사가 제공된다는 기대를 주고 싶었기 때문입니다.“라고 말했다.

현재 에피소드들에 대해서는 이미 그렇게 하고 있으며, 애플은 백 카탈로그도 처리할 계획이지만, 이는 우선순위가 낮아 목표 날짜는 발표되지 않았다.

영화관을 위한 첫 번째 자막 시스템을 만든 래리 골드버그는 자막이 이제 비디오 콘텐츠의 표준이 되었으며, 다른 회사들도 애플의 선례를 따라 팟캐스트 전사가 표준이 되기를 바란다고 말했다.

댓글 영역

획득법

① NFT 발행

작성한 게시물을 NFT로 발행하면 일주일 동안 사용할 수 있습니다. (최초 1회)

② NFT 구매

다른 이용자의 NFT를 구매하면 한 달 동안 사용할 수 있습니다. (구매 시마다 갱신)

사용법

디시콘에서지갑연결시 바로 사용 가능합니다.